英特尔+百度智能云,携手加速AI时代智能跃迁

在2024年9月25日-26日举办的2024百度云智大会上,作为大会的 联合主办方, 英特尔带来了 AI全栈软硬件方案, 深入讲解了如何基于英特尔 ® 至强 ® 处理器和新一代极具性价比的加速卡高效地部署和运行大语言模型,并展示了一系列优化策略和面向企业客户的开放架构AI软件栈(OPEA),以帮助企业加速AI落地,并最大化地发挥整个AI基础设施的计算效能。

长期以来,百度智能云与英特尔在产品和技术上深入合作,在云计算、大数据、飞桨PaddlePaddle深度学习框架优化、车路协同、边缘计算等领域都交出了亮眼的合作成绩。

现在,就跟着小编的步伐,一起来瞧瞧现场精彩亮点!

英特尔闪亮登场大会主论坛, 深入阐述“AI 驱动产业「芯动力」”的业务洞察和技术前瞻

主论坛演讲

AI 驱动产业「芯动力」

“为拥抱以AI为代表的新质生产力,英特尔携手百度为云数据中心构建现代化基础设施、持续优化软件,并在绿色可持续发展等领域深耕。以多年合作为基础,未来双方将继续通过不断的技术创新打造多样化解决方案,为各行各业的客户提供更优质的服务和体验。”

—— 梁雅莉

英特尔市场营销集团副总裁

中国区云与行业解决方案和数据中心销售部总经理

在主论坛之后,英特尔专场围绕如何为 AI 产业注入「芯动力」展开,从先进的技术与产品,再到合作解决方案,全方位介绍英特尔的 AI 产品硬软件组合,以及与百度智能云千帆大模型平台的最新合作成果。

英特尔专场

-

开场致辞

胡凯 英特尔云与行业解决方案集团互联网行业总监

不同行业对AI算力的需求是多样化的,对处理器频率、带宽等的需求各不相同。从云到边再到端,英特尔 持续为AI行业提供全面的产品技术组合, 并联合广泛的合作伙伴,为最终客户提供 更加经济和多样化的算力支撑。

-

基于CPU的大语言模型推理——百度智能云千帆大模型平台落地实践

陈晓宇 百度智能云资深研发工程师

大模型在各行业的广泛应用驱动了新一轮产业革命, 也让AI算力面临严峻挑战。作为国内领先的人工智能云服务平台,百度智能云千帆大模型平台为开发者提供了丰富的大模型选择和模型、应用开发的配套软件工具,能够帮助用户构建各种智能应用。

为了提升基于CPU的LLM推理性能,百度智能云引入 英特尔 ® 至强 ® 可扩展处理器, 并利用内置的 英特尔 ® 高级矩阵扩展技术, 搭配大模型推理加速方案 xFasterTransformer (xFT), 助力用户在千帆大模型平台上 实现基于CPU的LLM推理加速。 目前,千帆大模型平台已在 教育、办公、医疗 等多个场景 输出优秀应用案例。

-

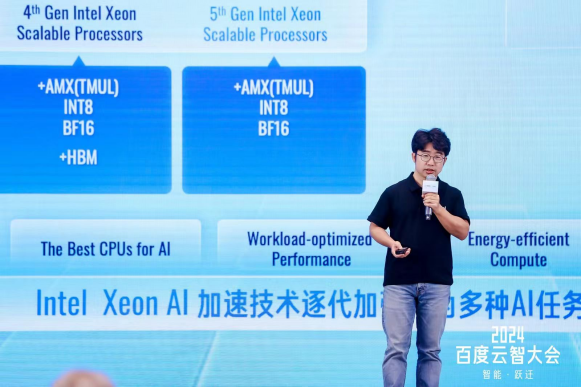

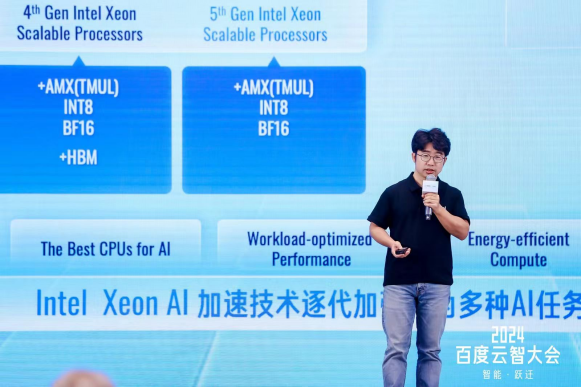

xFT解锁至强 ® 算力,释放AI潜能

缪金成 英特尔高级软件工程师

英特尔致力于输出AI领域的完整软硬件方案,配备英特尔 ® AI引擎的至强 ® 可扩展处理器,全面提升开箱即用的AI应用性能。第四代和第五代英特尔 ® 至强 ® 可扩展处理器内置的AI加速器—— 英特尔 ® 高级矩阵扩展引擎, 由2D寄存器文件 (TILE) 和TMUL组成,支持INT8和BF16两种数据类型,可有效加速深度学习训练和推理工作负载。

作为一款 充分优化的开源LLM推理框架,xFT 支持多机跨节点分布式运行,并支持C++和Python两种API接口,更易于用户使用和将其集成到自有业务框架中。同时,xFT支持 多种低精度数据类型和市面上的多款主流大模型。

-

基于检索增强生成的企业GenAI开放平台的全栈落地实践

郭彬 英特尔高级云计算软件架构师

尽管基于检索增强的RAG技术并非新生事物,但其在企业中的应用潜力正随着大语言模型的能力增强而日益凸显。企业AI落地面临的挑战与机遇并存,特别是在生成式AI技术引爆市场之后,行业关注的焦点已 从模型预训练转向了具体的应用落地。

OPEA(Open Platform for Enterprise AI)开放平台 是一个由英特尔发起并捐赠给Linux基金会的开源项目,其旨在 构建一个开放的AI软件生态系统, 利用生成式AI助力企业挖掘数据价值,切实助力自身业务发展,降低生态系统复杂性以实现解决方案规模化。

-

极具性价比的大模型解决方案

慕延峰 英特尔软件技术经理

大模型的发展如火如荼,随着模型参数规模的快速增长,企业对提升算力的需求日渐迫切。要有效地发掘大模型的价值,企业需要在避免单一GPU锁定的同时,提升系统的可扩展性,在提升业务效率的同时,有效控制成本。

英特尔 ® Gaudi ® 2 AI加速器,专为生成式AI和大模型而设计, 旨在提供高性能、高效率的生成式AI计算能力。作为一款完全可编程的高性能Al加速器,其融合了诸多技术创新,具备高内存带宽/容量和基于标准以太网技术的横向扩展能力。同时,英特尔提供以 英特尔 ® Gaudi ® 软件套件 为核心的端到端AI软件栈,让AI模型的开发与部署驶入快车道。

除了英特尔专场,在大模型和云原生专题中,英特尔技术专家们也带来了干货满满的分享。

大模型平台技术实践论坛专场

-

解锁至强 ® 潜能—大模型推理新选择

郭彬 英特尔高级云计算软件架构师

生成式AI引发的算力需求在持续增加,面对GPU缺货、价格高昂等问题,企业需要找到能够持续为生成式AI提供充足算力,并 兼具可扩展性、可获得性 的新选择。

面向AI时代,英特尔 ® 至强 ® 平台持续更新迭代,在算力能力不断提升之外,增添AI加速引擎。使用英特尔 ® 至强 ® 可扩展处理器提供的 英特尔 ® 高级矩阵扩展引擎, 用户可以更充分地挖掘CPU的潜力,更轻松地获得AI工作负载所需的性能。

云原生论坛

-

大模型时代的数据安全,至强 ® 处理器及机密计算的关键角色

宋川 英特尔数据中心及人工智能事业部首席工程师

在大模型时代,算力需求固然关键,但 数据安全和流通同样不容忽视。 随着大模型应用在各行各业的不断拓展,数据量呈爆发式增长,实现数据的有序流通,加强数据安全防护,对于推动大模型技术的持续进步至关重要。

英特尔 ® 至强 ® 可扩展处理器配备多种 安全引擎, 可提供基于硬件的机密计算解决方案,并且在充分利用数据的同时更好地保护数据隐私。其中, 英特尔 ® SGX 可提供 应用级安全隔离, 而 英特尔 ® TDX 可提供 虚拟机级别的安全隔离。

最后,跟随小编的脚步一起来「云」逛英特尔展区,领略现场的魅力!

围绕 大模型优化及部署、 最新发布的 英特尔 ® 至强 ® 6 处理器 和 AI PC 三大热点话题和产品,英特尔展出了丰富的产品和解决方案。

大模型优化及部署

-

解锁至强 ® 潜能,千帆推理新选择

-

安全可信的LLM推理服务:英特尔 ® TDX在异构计算中的应用

-

基于Arc TM GPU的LLM推理方案

英特尔 ® 至强 ® 6

-

英特尔 ® 至强 ® 6 处理器提供极致性能

AI PC

-

OpenVINO T M 工具套件和英特尔AI PC加速AIGC技术和应用

-

AI PC畅玩黑神话悟空与各类AI应用

依托十余年的技术合作积淀,英特尔将持续携手百度智能云,通过全栈的算力、强大的AI加速能力以及完善的端到端合作生态,共同推动生成式人工智能(GenAI)技术创新和行业落地,把技术能力变成生产力,服务千行百业的智能化建设!

京公网安备 11010802033920号

京公网安备 11010802033920号